博士论文 面向骨伤幸存者辅助救援的仿生搬移机器人研究

摘 要

破坏性的自然灾害如地震、火灾事故时有发生,已经成为我国乃至全世界对人类生命和财产安全的重要威胁之一。特别是在城市中,自然灾害导致的危楼中存在大量被困幸存者。应用机器人技术对受伤幸存者开展快速且有效地救治、搬移、转运具有重要意义。然而已有的面向骨伤伤员搬移任务的机器人,更多关注的是搬移、转运的效率,并未着重考虑骨伤幸存者易受到搬移过程二次伤害的问题,无法满足实际救援中对骨伤幸存者安全高效救援的需求。本文受骨伤幸存者人工搬移操作方法的启发,提出了仿生辅助搬移机器人设计方法,用于高效再现人工搬运对脊柱的保护机制。基于搬移过程中人体支撑机理分析进行仿生研究,以满足骨伤伤员搬移的任务作业能力,提升机器人感知决策能力,保证操作过程安全性为研究目标,开展仿生辅助搬移机器人系统研究。主要研究工作和相关结论如下:1)仿生辅助搬移机器人设计与单元系统测试。开展基于人工搬运原理的仿生辅助搬移机器人设计,基于工作空间分析和结构轻量化设计实现负载 120kg 的大负载自重比机械臂设计。基于对人工搬运中脊柱保护机制的解析,开发基于多段式固定的仿人搬移工具。研究不同接触部位的差异化设计,柔性接触结构、地面自适应机构及拓扑优化设计等关键技术。针对仿人搬移工具的工作空间及夹持力开展性能试验研究,验证了仿人搬移工具对不同伤员尺寸和姿态的适应性和实用性。2)仿生辅助搬移机器人运动学及关键参数标定。基于仿生辅助搬移机器人结构特点的分析,构建了机械臂和移动平台联合的运动学模型,提出了逆运动学解析解求解方法,并通过仿真分析验证了正、逆运动学模型的准确性。研究基于不同相机设置的关键参数标定方法,获取了机器人自动引导控制中全局视角和局部视角的关键相机参数。针对肢体精准定位的难题,建立了基于合作目标的人体肢体定位成功率的评价方法。3)面向搬移操作的伤员体重估计及尺寸测量。为提升机器人进行搬移操作的安全性,提出了一种基于单张图像的人体体重估计方法。通过研究人体模型重建、人脸模型重建、图像深度特征提取关键技术,提出了包括上躯干高度与腹部面积比、脸颊面积占比等的多种虚拟测量参数,并验证了测量参数的相关性。提出基于人脸测量特征、人体测量特征、深度特征融合回归的三分支体重估计网络框架,通过在不同数据集上进行的算法对比性能试验,实现了最优的预测效果。通过大量消融试验,验证算法各个模块的有效性,通过数据集及实际试验证明,该算法有效降低了二维图像到三维空间的模糊性。4)基于深度强化学习的机器人自动引导控制研究。为提升伤员救援机器人操作效率,提出一种基于深度强化学习的机器人自动引导控制方法。基于双视角图像及预训练的人体语义特征提取器,建立了面向肢体定位的机械臂自动引导控制框架,通过交叉注意力机制实现了不同视角特征的相互推理。面向人体个性化姿态和穿着导致的虚实迁移难题,提出了基于人体模板固定语义的人体重建模型匹配全局图像的方法,并在不同体重和姿态下进行性能测试。仿真和实际环境的大量试验表明,所提出的方法在人体肢体自动引导任务的成功率显著高于基于日常物品操作预训练的现有方法,为提升机器人操作控制效率提供了新的参考。5)仿生辅助搬移机器人系统集成设计与性能试验。在机器人结构优化、算法开发的基础上,集成开发了仿生辅助搬移机器人样机系统,研究面向实际救援场景的机器人硬件、软件设计关键技术。在集成后的样机系统上进行了最大负载能力、搬移过程人体安全性的试验测试。试验结果验证了机器人的关键性能指标。通过搭建伤员救援任务模拟环境,验证了机器人危楼特殊地形通过性及伤员搬移、伤员转运作业的任务完成能力。

AbstractDestructive natural disasters such as earthquakes and fires occur frequently, posinga significant threat to human life and property safety in China and around the world.Particularly in urban areas, natural disasters can leave many survivors trapped indangerous buildings. The use of robotic technology for the rapid and effective rescue,transfer, and transportation of injured survivors is crucial. However, existing rescuerobots that focus on bone injury survivors mainly emphasize efficiency in transfer andtransportation without specifically addressing the risk of secondary injuries duringtransport; thus, these robots fail to meet real-world rescue needs for bone injurysurvivors.Inspired by manual handling methods used by rescue personnel for bone injurysurvivors, this paper proposes a bioinspired assistive transfer robot design method toefficiently replicate the spinal protection mechanism of human handling. This research,which is based on an analysis of human body support mechanisms during transfer, aimsto fulfill the operational capabilities for bone injury survivor transfer tasks, enhancerobot perception and decision-making abilities, and ensure safety during operation bydeveloping a bioinspired assistive transfer robot system. The main research work andrelated conclusions are as follows:1) Design and system testing of the bioinspired assistive transfer robot:Implementing a bioinspired assistive transfer robot design on the basis of manualhandling principles, with a focus on workspace analysis and structural lightweightdesign to achieve a high load‒to‒weight ratio arm capable of carrying up to 120 kg. Onthe basis of an analysis of the spinal protection mechanisms used in manual handling,a multi-segment fixed bioinspired transfer tool has been developed. Research includesdifferentiated designs for different contact parts, flexible contact structures, ground-adaptive mechanisms, and topology optimizations. Performance tests on the workspaceand clamping force of the bioinspired transfer tool have verified its adaptability andpracticality for different sizes and postures of casualties.

目录

摘要

abstract

第1章 绪论

1.1 研究背景与意义

1.2 伤员救援机器人研究现状

1.3 伤员身体三维模型重建的研究现状

1.4 基于图像的人体体重估计研究现状

1.5 基于深度强化学习的机械臂引导控制研究现状

1.6 本文研究内容和技术路线

第2章 仿生辅助搬移机器人设计与分析

第3章 仿生辅助搬移机器人运动学建模与参数标定

第4章 面向搬移操作的伤员体重指数估计

第5章 基于深度强化学习的机器人自动引导控制研究

第6章 仿生辅助搬移机器人性能试验研究

第7章 总结与展望

参考文献

第 1 章 绪论

1.1 研究背景与意义破坏性的自然灾害如地震、火灾事故时有发生,已经成为我国乃至全世界对人类生命和财产安全的重要威胁之一。近年来,我国发生了天津滨海新区危险化学品爆炸,汶川地震等一系列的国家重大公共安全事件。这对于应急救援中装备布置的快速性以及处理的高效性提出了迫切要求。在发生重大灾难时,消防和救援服务的首要任务是在事故现场寻找幸存者,并在黄金 48 小时之内救治伤员。随着我国城镇化水平的提升,发生重大灾害(火灾、地震等)后,城市内的灾害现场大部分是危险建筑废墟,狭窄楼内通道等恶劣室内环境。危楼废墟环境中伤员的高效安全救援一直是救援难题。目前,危楼废墟内的伤员救援相比其他场景存在三个挑战:楼内空间小导致无法容纳大量的救援队员和设备;楼内随时有坍塌风险,严重威胁救援队员安全;楼内伤者人员密度大,无法在短时间内完成所有伤员的救援。

危楼救援场景

目前,危楼内部伤员救援的方式主要依赖人工和辅助装备。为解决救援任务繁重和救援人员严重不足的矛盾问题,众多研究机构纷纷开展救援机器人的研究工作。通过救援机器人来协助或代替传统救援人员的工作,提升救援的效率和安全性。急救医学研究证明,不同伤情的伤员必须采用不同的救援方式,来最大程度地避免人体受到二次伤害。在 2008 年我国汶川地震的伤员伤情分布情况研究中,Jin 等[1]通过统计学的方式研究了 1856 名伤员的受伤情况,其中四肢损伤和躯干损伤的伤员占比高达 85.5%,而躯干损伤中脊柱损伤的伤员占比达到了 41.2%。Ikuta, Eisuke 等[2]研究分析了 1995 年日本阪神地震震后的医院外科救治记录,结果显示伤情中占比最高的前三位分别是创伤性窒息、脊髓损伤和复合挤压伤。Min[3]统计了华西医院在 2010 年我国玉树地震后的接诊伤员病例,其中脊柱损伤伤员数量仅次于上肢骨折和下肢骨折伤员数量,占比排在第三位。陈长坤等[4]统计了巴基斯坦、海地、尼泊尔等几次重大地震后的致伤原因、受伤部位及受伤类型,统计结果显示前三位的受伤类型为四肢骨折占比为 52.6%,全身软组织损伤占比 21.5%,脊柱骨折占比 5.4%,可见上、下肢损伤和脊柱损伤是占比最高的三类伤情,对于无行动能力伤员,需要救援人员对受伤部位处理、固定后再进行搬移、转运,其中救援难度最大是脊柱损伤伤员。有统计显示,约 20%的脊柱损伤伤员在入院前死亡,高达 25%的脊柱损伤在搬移和运输中由于操作不当受到了二次伤害导致病情加重,其中多数幸存伤员往往需要接受多次甚至终身治疗,对伤员的后续生活和社会都造成了巨大的负担。

1.2 伤员救援机器人研究现状国外早在上世纪就提出了救援机器人的概念,通过部署不同类型的移动机器人可以帮助救援人员更快地定位伤员,已经有很多救援机器人研究成果应用到了真实救灾场景中。2001 年世界贸易中心袭击后,移动机器人 PackBot 参与了救援任务[5]。2004 年日本东京工业大学研制的 Souryu 机器人参与了日本新宿地震救援[6]。我国救援机器人研究起步较晚,中国科学院沈阳自动化研究所研制的机器人 AMOEBA[7]在四川芦山地震灾后救援中执行了生命探测和搜救任务。目前已经应用的机器人,功能上更侧重于生命探测或信息采集,无法完成伤员搬移、转运。从技术路线上划分,已有研究中能够完成伤员转移和搬运的机器人可以分为双臂型救援机器人和复合型救援机器人两类。

生命探测和搜救机器人

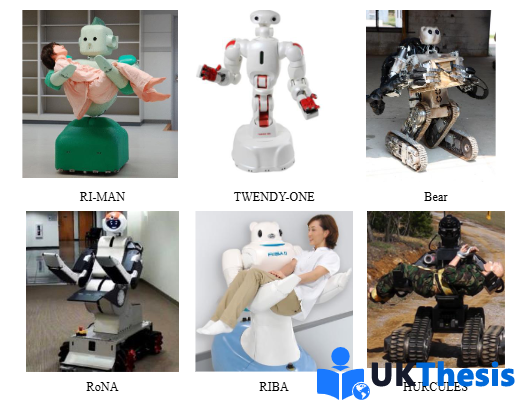

1.2.1 双臂型救援机器人研究现状双臂型机器人的研究最早可追溯到 1959 年,美国 Sandia 实验室开发了双臂型机器人用于操作深海中的放射性物质[8]。在此之后越来越多的研究机构和企业开始进行双臂型机器人的研究。在工业领域中双臂型机器人得到了很多应用,美国 Rethink Robotics 公司生产的 Baxter 机器人[9]可完成物品抓取、拆解包装等操作。瑞士 ABB 公司研制的 Yumi 机器人能够完成精密零件的装配,并配有安全保护机制。德国航空航天中心(DLR)研制的 Rollin Justin 机器人[10],可用于协助宇航员太空作业,能够完成复杂的双臂协作任务。我国新松公司研制的 Duco机器人,通过协作型双臂能够完成装配和调酒等操作。工业领域应用的双臂机器人虽然能够实现高精度的双臂操作,但因其负载能力和人机交互性的限制无法应用于医疗看护、战场救治等场景中。面向人机安全操作的双臂型机器人可追溯到 2006 年日本仿生研究中心发布的 RI-MAN 机器人[11],应用了双臂抱运人体的概念,能够执行医疗护理工作,但其负载能力只有 18kg。日本早稻田大学在 2007 年研制的 TWENDY-ONE 机器人[12]可辅助人完成一些日常负重操作任务。美国军方于 2008 年公布了一款 Bear(Battlefield Extraction-Assist Robot)战场救援机器人[13],该机器人采用仿人形上肢设计,双臂为液压伸缩驱动,双臂最大负载可以达到 240kg,在行走机构上采用履-腿复合式设计,能够适应不同路况环境。日本理化研究所于 2015 年开发了一款 RoNA 机器人及相同原理的 RIBA 机器人[14],该机器人与 Bear 机器人结构形式类似,同样采用仿人双臂设计,能在医院内辅助护士完成病人移送操作,在行走机构设计上采用麦克纳姆轮的全向移动方式,更适应室内环境应用。相比 Bear 机器人,RoNA 机器人在与人接触的部位增加了柔性材料,并通过增加力传感器提升舒适性,负载能力为 63kg。韩国国立首尔大学于 2019 年开发了一款 HURCULES 机器人[15],该机器人采用电机驱动的多关节机械双臂实现人体的抱运操作,行走机构的设计采用和 Bear 机器人相似的履-腿复合结构。相比 RoNA 机器人和 Bear 机器人,该机器人设计了伤我国在仿人形双臂机器人的研究多集中于精细操作型双臂机器人,大负载的伤员搬移双臂机器人研究较少,其中典型的研究包括香港中文大学 2017 年开发的 RescueRot 救援机器人[16],双臂各具备 4 个自由度,采用了最大负载 250kg 的履-腿复合式移动平台,操作人员可以通过穿戴设备进行双臂控制,最大负载设计为 85kg。中国科学院沈阳自动化研究所于 2019 年开发的双臂型救援机器人[17]在形式上与 RescueRot 类似,同样采用了履-腿复合式移动平台设计,机器人双臂各有 6 个自由度,在执行救援任务的操作上相比 RescueRot 更加灵活,双臂都采用多关节电机驱动,双臂最大负载可达 75kg,对于伤员搬移同样采用了双臂搬抱的方式,为了提升双臂执行伤员搬运任务时伤员的舒适性和安全性,机械臂各个关节与人接触的部分都采用了柔性材料。目前已有的仿人双臂机器人已经能够完成人体的抱起、转移等操作,其工作过程都是通过模仿人工抱运的方式,首先将双臂伸入伤员的背部和腿部下,之后通过调整机器人腰部关节的角度实现双臂的同时抬起,最后调整双臂关节位置完成伤员的抱起。对于有脊柱骨伤的伤员,双臂型机器人从单侧伸入人体下并抬起的搬移方式,势必会导致搬移过程中人体脊柱角度的大幅度变化,同时缺乏对颈椎和肢体的固定,容易引发伤员的二次伤害,难以实际应用到骨伤伤员的救援中。

协作型双臂机器人

1.2.2 复合型救援机器人研究现状复合型救援机器人与双臂型机器人在搬移人体的技术实现路线上有本质的不同,其主要区别在于复合型救援机器人通常不采用搬抱人体的方式,而是采用拖拽人体或整体夹持人体方式来实现人体位置的转移。复合型救援机器人采用拖拽人体的方式可以降低机构的负载设计要求,2007年美国陆军研制的 REV 伤员后送机器人[18]可以将伤员进行收纳,快速转移至安全区,但伤员从地面到升降担架的搬移需人工或 REX 机器人拖拽完成。日本消防厅研制的 RoboCue 机器人[19]采用输送带和双臂复合的方式来搬移人体,通过夹持伤员衣服将其平缓放置在自动输送带上,后通过输送带回收完成伤员搬移操作。2018 年美国专利也公布了相似原理的 SAVER 机器人[20]方案,双臂调整伤员姿态后,通过肩部固定装置进行伤员的拖拽。英国帝国理工大学 2021 年开始研发 ResQbot 系列机器人[21],该机器人的伤员转移机构设计在轮式移动平台上,主要用于室内环境的救援任务,第二代新增设计了充气型结构来固定伤员头颈部和肩部,之后结合传送带倾斜的方式将伤员搬移到机器人上,与 RoboCue 机器人相比,该机器人虽然结构简单,但对被操作伤员的初始姿势有很严格的限制。具有类似原理的机器人还包括日本研制的 Stretcher 系统[22],采用两段传送带的方式将人体转移到机器人上,操作过程需要人工辅助。2022 年奥地利研制的 RTE机器人[23]通过机械臂将绳索固定在人体上后,再通过拉动绳索将人体拖拽到机器人上。拖拽人体方式虽然降低了机器人驱动的复杂度,但拖拽过程无法保证人体脊柱保持中立位,并不适用于骨伤伤员的转移。我国在复合型救援机器人的研究起步较晚,多是针对野外开阔场景的伤员救援,主要目标是解决非骨伤伤员的拾取和转运问题。有代表性的研究成果有中国科学院沈阳自动化研究所 2021 年研制的伤员拾取机器人,通过机械臂夹持伤员衣服的方式将伤员抬至担架上,之后将担架抬起回收至机器人舱内,完成伤员的搬移和转运。同年燕山大学研制了一种多臂协作式救援机器人[24],通过多臂环抱的方式支撑伤员身体并将人体抬起,多臂同时支撑的方式分担了人体整体重量,缓解了人体局部部位的应力集中,多臂系统采用了相同的模块化设计,并没有考虑人体各个部位尺寸的差别,无法进行人体头颈和肢体的固定,同时多臂系统安装在机器人内部,导致机器人的宽度很大,只能适用于野外开阔的场景中。综上所述,已有机器人系统和结构形式虽然都无法适应危楼内部骨伤伤员的救援要求,但为后续骨伤伤员救援机器人设计提供了新的思路。

1.3 伤员身体三维模型重建的研究现状伤员救援机器人在进行人体操作前需要以人体信息作为输入条件,来保证伤员的安全,其中伤员身体的三维重建模型是最重要的数据之一。从视觉中重建人体模型一直是计算机视觉研究的热点之一,在过去的二十年中,从 RGB 图像中预测人体关键点、轮廓、语义分割信息已经取得了很多优秀的成果。但一方面现实环境中人体复杂的姿态很难用 2D 信息或稀疏 3D 关节表示清楚,需要更精细的描述;另一方面人体是通过皮肤而非关节与现实交互,因此对于人体肢体、姿势的重建是非常重要的。

1.3.1 基于数据累计方法的研究现状人体三维重建最直观的方法是通过 3D 扫描设备对人体表面进行扫描,微软和谷歌都曾采用多视角的深度相机和红外相机进行高质量的人体深度信息预测,通过空间点云的拼接进行人体的几何重建。虽然多视角相机重建方法得到了最高质量的模型,但搭建成本高、重建耗时长、流程复杂,限制了其应用的领域。随着消费级深度传感器如 Kinect、ZED 相机的研发,越来越多的研究开始专注于通过深度相机来重建场景的三维几何。DynamicFusion[25]是具有代表性的算法之一,其借鉴了 KinectFusion[26]中多个深度图融合的方法,通过输入单个深度相机的深度信息,结合非刚性变形表示来处理动态物体重建的问题。为解决动态人体模型非刚性配准不确定性的问题,有研究开始在模型中增加人体先验信息来应对复杂人体姿态,BodyFusion[27]算法使用了预先定义的人体模板作为初始模型,结合人体关节约束了网格非刚性变形。DoubleFusion[28]算法使用了双层模型结构来处理人体形状和局部细节,结合基于体素和表面模型的非刚性配准方法,提升了动态人体的重建精度。Fusion4D[29]、UnstructuredFusion[30]则是通过使用多个消费级深度相机扫描人体的方式来消除使用单台设备时存在的盲区,并得到了高质量的人体重建模型。目前基于数据累计的方法已经能够重建高质量的人体模型,但也导致其模型顶点数目非常多,实时性差。使用人体模板来约束网格变形可以显著提升计算速度,但由于自扫描约束的限制,重建质量非常依赖一个准确的初始模型。在危楼内伤员救援场景中,机器人计算资源有限且无法提供伤员高质量的初始模型,导致基于数据累计的方法很难到达预期的重建效果。

1.3.2 基于人体模板方法的研究现状早期的人体模板采用的是基于几何图元拼接的方法,Marr 等[31]采用圆柱体拼接表示人体,Pentland 等[32]建立了物理约束模型来跟踪人体跳跃动作,此外还有采用椭球、变形球等方法来表示人体,但都不具备逼真的人体网格。随着 3D扫描技术的发展,更多的研究开始关注人体统计模型的建立,将 3D 扫描得到的密集点云数据转化为可动画的 3D 人体网格,其中 SCAPE[33]和 SMPL(SkinnedMulti-Person Linear Model)[34]是两个最具代表性的模型,SCAPE 和 SMPL 都是可变形的人体模型,都采用形状参数和姿态参数,SCAPE 中的形状参数表示了不同人体之间的身材差异,姿态参数表示同一个人体在不同姿态下的变化,通过稀疏控制点来表示人体的三维形状。SMPL 是基于 SCAPE 的一种改进模型,通过基于顶点的线性模型描述人体,模型中将人体形状表示为 10 维的参数向量,将人体姿态表示为 72 维的关节向量,相对 SCAPE 模型计算效率更高,更适合实时渲染和交互应用。随着对于 SMPL 模型研究的深入,Romero 等[35]建立了包含双手的 SMPL-H 模型,Pavlakos 等[36]建立了包含 FLAME 头部模型[37]和 MANO 手部模型[35]的 SMPL-X 整体模型。得益于 SMPL 开源社区的不断发展,越来越多基于预定义人体模板的算法被提出并取得了很好的效果。本节总结的方法都是针对衣服下人体的形状和姿势估计,并不考虑衣服和头发的重建。从方法上可以将这些研究分为两类:基于优化的方法和基于回归的方法。基于优化的方法将参数化的人体模型拟合到 2D 图像上,基于回归的方法是利用深度神经网络直接从 2D 图像的像素中回归得到模型参数。基于优化的方法主要通过目标函数来估计得到与 2D 图像一致的模型,目标函数通常包括数据项和正则化项,数据项用于约束 2D 图像中人体与网格模型的重投影误差,而引入正则化项是为了得到更合理化的人体关节角度。在早期的工作中,需要手动提供关键点用于得到初始的 3D 关节人体姿势和形状[38]。随着OpenPose[39]等 2D 关键点检测算法的进步,Bogo 等[40]提出了基于 SMPL 模板的SMPLify 方法,首次通过迭代将 SMPL 模型拟合到检测到的 2D 关键点,应用最小化能量函数的方法进行优化,包括数据项中惩罚 2D 关节关键点和 SMPL 关节之间的距离,通过姿势先验来避免模型中不合理的关节角度,形状先验来避免生成极端的人体体型,碰撞惩罚避免模型中肢体的穿插。不同于 SMPLify 只采用了 2D 关键点,Lassner 等[41]提出的方法结合了人体语义分割、关键点、轮廓进行了多线索的分析,HoloPose[42]通过训练包括 2D、3D 关键点和 DensePose[43]估计的多任务网络来促进模型和图像对齐。还有研究如 HybrIK[44]引入了人体关节运动的逆运动学,设计了自适应逆运动学算法来估计更合理的关节角度。Li 等[45]提出将正逆运动学过程结合,通过可逆神经网络来显式解耦有部分遮挡的人体姿态。基于回归的方法使用深度学习来直接处理图像像素,在网络架构上都包含了编码器和解码器。编码器用于提取输入图像的特征,解码器将图像特征作为输入并输出回归的结果,目前的网络结构设计上可分为三种框架,单一阶段框架从RGB 图像中直接预测人体姿态和形状,不产生中间特征。多步阶段框架将预测分为一系列子任务,通过中间特征来重建人体模型。多分支框架通常将人体的姿态和形状放在不同的分支中进行解算。单一阶段框架中编码器通常会采用成熟的ResNet[46]、HRNet[47]等作为特征提取的主干网络,解码器方面,HMR(Human MeshRecovery)[48]采用了迭代误差反馈的方法,但重复使用全局特征,会导致重建模型的错位。PyMAF[49]在重建过程中通过将网格与空间特征对齐的方式来反馈调节每 个 循 环 中 的 模 型 参 数 。 HMR2.0[50] 使 用 了 ViT[51] 作 为 编 码 器 和 标 准 的Transformer 解码器,通过多头注意力进行预测,取得很好的效果。多步阶段框架在回归过程中引入了中间特征来指导后续重建过程,如 Pose2Mesh[52]通过 2D 关节估计 3D 关节,之后通过中间 3D 网格来估计 3D 网格的顶点,其他方法还引入了轮廓、人体语义分割、光流等。多分支框架中有代表性的工作有 Pavlakos 等[53]设计了一个双分支的网络结构,一个分支以 2D 热图作为输入得到姿态参数,一个分支以掩码轮廓作为输入得到形状参数,并优化网格投影和 2D 注释的一致性。PARE[54]同样采用了双分支的架构,其中 2D 部分分支用于估计注意力权重,3D 身体分支用于回归模型参数,提升了有遮挡人体重建的鲁棒性。目前基于回归的方法更多地关注人体姿态的准确性,而忽略了人体形状的准确性,重建的效果都接近平均尺寸模型。在伤员救援场景下的应用更需要关注人体形状,为机器人的操作提供依据。为了预测更准确的人体体型,Sengupta 等[55]通过建立合成数据集,增加了很多运动员的极端体型。SHAPY[56]通过语言描述体型的特点和人体测量信息来改进人体的体型估计结果。Ma 等[57]模仿物理标记点的原理提出虚拟标记点作为中间表示的方法,在公共数据集上表现出了更好的形状预测效果。

国外仿人形双臂机器人

1.4 基于图像的人体体重估计研究现状

1.4.1 基于人脸数据的体重预测方法Coetzee 等[58]收集了 84 张男性,女性的脸部照片,通过对面部图像评分的方式发现脸部的肥胖率和 BMI(Body Mass Index)有关,之后通过比较三种面部测量特征,证明了三种特征与 BMI 的显著相关性。Tinlin[59]的研究表明年轻女性的脸部尺寸比身体尺寸对肥胖的影响更大。Stephen[60]将几何测量方法用于面部形状测量,提出了预测体重指数,体脂百分比的模型。为了确定面部尺寸和内脏肥胖之间的关系,Lee [61]通过对 15 个人脸特征的不同组合,评估了不同组合的预测能力。Wen 等[62]通过提取人脸中的关键点,提出了基于人脸七个特征值回归预测的方法,在 Morph 2[63]数据集上利用支持向量回归得到了优秀的 BMI 预测结果。Kocabey[64]提出了 VGG-Face 特征,并结合支持向量回归[65]的方法进行了 BMI预测。Jiang 等[66]在 Morph 2 和 FIW-BMI 数据集上对比了人脸几何特征和不同深度网络对结果的影响,证实了深度学习模型对比几何模型的优势。Siddiqui 等[67]分析了面部 BMI 预测方法在四个种族、性别中的偏差及不同预测网络之间的差异。Pascali[68]通过深度扫描来重建 3D 人脸,并提出通过重建模型几何特征来预测体重的框架,然而以上研究都是基于正面拍摄的人脸图像实现的,而较大的头部姿势变化会降低以上方法对 BMI 估计的性能。此外,面部特征只提供了脸部的信息,忽略了个性化的人体尺寸特征,这也导致了估计结果的不准确。

1.4.2 基于人体数据的体重预测方法Asgwell[69]通过 CT 图像评估了腰围和大腿围对女性肥胖的影响,分析了人体测量信息和腹内脂肪的相关性。Muller[70]的研究发现 6 种人体测量特征与体重有关,特别是针对腹部肥胖的预测,但在研究中没有考虑人群的差异性。考虑到人群中的差异性,Molarius[71]列出了不同于 Muller 的一些测量指标包括腰腿比、腰臀比、腰身高比和腰围等。进一步,Velardo 等[72]开始建立人体测量值与人体体重的关系,并通过回归模型在大数据集 NHANES[73]上基于人体测量数据来预测体重值。Nguyen[74]通过单张 RGB-D 图像进行了体重估计,并建立了 W8-400数据集。Nahavandi 等[75]提出一种基于 Kinnect 无骨骼模型的人体体重预测系统,利 用 体 表 的 面 积 来 进 行 体 重 的 估 计 。 Pfitzner[76] 基 于 ANN(Artificial NeuralNetwork)网络提出的体重估算方法,可以用来预测平躺,站立,行走三种姿态下的体重。Nastaran[77]通过基于模板的方法,利用深度神经网络模型提取局部特征,基于三维人体扫描结果自动提取人体测量值。类似的,Liu 等[78]通过变化视角的点云数据融合,估计并重建了人体的三维模型。然而,深度图像的方式受限于传感器性能,在室外环境应用效果不佳。相比于基于深度信息的方法,只基于 2D 图像的方法缺乏尺度信息,但提供了更丰富的应用场景。通过 2D 图像来实现体重测量是更通用的方法,Jiang 等[79]首次提出了将图像中人体轮廓的像素信息和关键点转化为人体测量特征的方法,从而通过人体测量特征来估计人体体重的变化,并建立了数据集。受以往工作的启发,Jin 等[80]优化了 Jiang 的方法,通过在轮廓中去除人体手臂的方法来增强人体测量信息的准确性,同时提出了两个额外的人体测量特征。

1.5 基于深度强化学习的机械臂引导控制研究现状传统工业机器人的引导控制都是通过示教预先定义路径点和运动指令来实现的,但在复杂的救援场景中引导机械臂定位人体肢体面临着姿态、体型不确定等问题,很难通过任务的提前部署来定位。在这种非结构化的场景中通过视觉引导机械臂作业是可行方法,机械臂的视觉引导从相机的安装位置上可分为全局相机和手眼相机,全局相机安装在工作台上方,可以得到俯视整个工作台的全局视角,通过相机的预先标定来获取目标物的位置,但在操作过程中目标物的位置可能被机械臂遮挡导致失败,手眼相机安装在机械臂末端,可得到目标物的局部视角,但视角范围受限于目标物的尺寸。

第 7 章 总结与展望

7.1 主要工作与结论

本文针对骨伤伤员救援任务,开展伤员救援机器人关键技术研究,以人工救援中多人对伤员的安全搬移操作为仿生蓝本,设计了一种仿生辅助搬移机器人系统,任务执行能力方面,能够实现大负载伤员搬移并确保人体交互的安全性。为进一步提升机器人的视觉感知与控制能力,在人体体重估计、尺寸测量、肢体自动引导控制方面进行重难点攻关。本文开展的研究工作总结如下:1)仿生辅助搬移机器人轻量化设计与单元系统测试研究本文针对骨伤伤员救援机器人安全搬运伤员的需求,提出了模仿人工搬运原理的仿生辅助搬移机器人设计方法,基于工作空间分析和结构轻量化设计实现了负载 120kg 的大负载自重比机械臂设计,提升了机械臂的控制稳定性。初步解析了人工搬运中人体各个部位的受力机理,提出了基于多段式固定的仿人搬移工具设计方法,采用不同接触部位的差异化设计和柔性人机接触材料设计实现了搬移过程中的人机安全交互,仿人搬移工具的工作空间及夹持力的试验结果表明,所研制的仿人搬移工具不仅可以适应不同人体尺寸,还能满足普通伤员和携带半担架伤员的夹持力需求。2)仿生辅助搬移机器人运动学及关键参数标定方法研究本文分析了仿生辅助搬移机器人的结构特点,建立机械臂和移动平台的联合运动学模型,提出了逆运动学解析解求解方法,并通过仿真验证了正、逆运动学模型的准确性。基于不同相机设置的关键参数标定研究,建立了基于合作目标的人体肢体定位成功率评价方法,为后续章节中肢体自动引导控制性能评价提供了有效支撑。3)面向搬移操作的伤员体重估计及尺寸测量方法研究为提升机器人进行人体操作时的安全性,预先输入人体信息如体重、尺寸等个性化信息至关重要。为了快速得到相关信息,本文提出了一种基于单张图像的人体体重估计方法,结合人体模型重建、人脸模型重建、图像深度特征提取方法,提出了包括上躯干高度与腹部面积比、脸颊面积占比等虚拟测量参数,并验证了测量参数的相关性。建立了基于人脸测量特征、人体测量特征、深度特征融合并回归的三分支体重估计网络框架,并在新建立的包含图像、三维重建模型的大规模数据集和公开数据集进行了算法对比试验,验证了算法的优越性。通过大量消融试验,分析并验证了算法各个模块的有效性,试验结果表明,算法有效降低了二维图像到三维空间的模糊性。4)基于深度强化学习的机器人自动引导控制研究为提升伤员救援机器人感知决策能力和操作效率,本文提出了一种基于深度强化学习的机器人自动引导控制方法,基于双视角图像及预训练的人体语义特征提取器,构建了面向肢体定位的机械臂自动引导控制框架,并引入交叉注意力机制实现了不同视角特征的相互推理。针对人体个性化姿态和穿着导致的仿真到实际迁移难题,提出了基于人体模板固定语义的人体重建模型匹配全局图像的方法,结合消融试验,测试了方法在个性化体重和姿态的性能。仿真和实际环境验证试验表明,所提出的方法在人体肢体自动引导任务中的成功率显著高于基于日常物品操作预训练的方法,为进一步提升机器人操作的智能控制能力提供了新的参考。5)仿生辅助搬移机器人系统集成设计与性能试验研究在前四章工作的基础上开发了仿生辅助搬移机器人样机系统,从硬件、软件等方面详细介绍了仿生辅助搬移机器人的设计方法和系统组成。在集成后的样机系统上进行了最大负载能力、搬移过程人体安全性的试验验证,试验结果验证了机器人的关键性能指标。本文通过搭建伤员救援任务模拟环境,验证了机器人危楼狭窄空间通过性,以及完成伤员搬移和伤员转运作业任务的能力。

7.2 创新点

1)受针对骨伤伤员的人工搬运方法启发,提出了基于人体多段式安全固定的仿生辅助搬移机器人设计方法,突破了仿生辅助搬移机器人的集成制造及多维度评测技术,显著提升了机器人化搬移伤员的安全性和可靠性。2)提出了基于单张二维图像的人体体重估计方法,结合人体三维模型重建技术提出了多项人体虚拟测量参数,降低了二维图像到三维空间出现的模糊性,开发了基于多维特征融合、回归的体重估计网络框架,显著提升了通过图像估计人体体重指数的精度。3)提出了基于深度强化学习的机器人自动引导控制方法,构建了基于人体语义特征提取及双视角特征融合的网络框架,实现了面向人体肢体定位的机器人自动引导控制,结合人体模板的固定语义解析,克服了从仿真向实际迁移的局限性,为机器人对肢体的精细化操作提供了新的参考。

7.3 研究展望本研究

在骨伤伤员的机器人化自动搬运中的任务执行能力和视觉感知控制关键技术上取得了一定进展,但仍存在不足之处,未来工作可以在以下方面进行更深入的研究和探索。1)本研究设计的仿生辅助搬运机器人在和人体接触的部分尚未集成力传感器,缺少真实灾害救援任务的系统测试机会,无法完全保障机器人进行人体搬运过程中人机交互的舒适性。未来需进一步开展人机接触机构的仿生设计研究,增加接触力控制算法,提升人机接触的舒适性,并在实际救援作业中收集更多数据,用于机器人系统方案的改进优化。2)本研究提出的基于单张图像的人体体重估计方法,目前仍受限于数据集样本的多样性,易对极端体重的估计产生较大误差,未来可以针对伤员救援场景,通过招募志愿者的方式拓展数据集样本量,提升体重估计方法的适用范围。3)本研究提出的基于深度强化学习的机器人自动引导控制方法,目前还仅依靠图像特征进行机器人导航,尚无法完全应对肢体遮挡、残缺的极端情况。未来可增加如红外相机、激光雷达等传感器,利用多源传感信息融合的自动引导方法,增强算法在复杂伤员救援场景环境的鲁棒性。

参考文献

[1] Wen J, Yang C L, Shi Y K, et al. A retrospective study of geriatric trauma at alarge teaching hospital after the 2008 Wenchuan earthquake [J]. InternationalJournal of Gerontology, 2010, 4(3): 115-119.[2] Ikuta E, Miyano M, Nagashima F, et al. Measurement of the human body damagecaused by collapsed building[C]//Proceedings of the 13th World Conference onEarthquake Engineering. Vancouver, Canada: 13WCEE, 2004: Paper No.628.[3] Min L, Tu C Q, Liu L, et al. Management of limb fractures in a teaching hospital:comparison between Wenchuan and Yushu earthquakes [J]. Chinese Journal ofTraumatology, 2013, 16(01): 16-21.[4] 陈长坤, 王小勇, 雷鹏,等. 重大地震震后伤员伤情特点综合分析 [J]. 华北地震科学, 2019, 37(04): 18-22.[5] Blackburn M R, Everett H, Laird R T. After action report to the joint programoffice: Center for the robotic assisted search and rescue (crasar) related efforts atthe world trade center [J]. Technical document, 2002, 3141-3148.[6] Masayuki A, Takayama T, Hirose S. Development of" Souryu-III": connectedcrawler vehicle for inspection inside narrow and winding spaces[C]//2004IEEE/RSJ International Conference on Intelligent Robots and Systems(IROS)(IEEE Cat. No. 04CH37566). IEEE, 2004, 1: 52-57.[7] Li B, Ma S, Liu J, et al. AMOEBA-I: a shape-shifting modular robot for urbansearch and rescue [J]. Advanced Robotics, 2009, 23(9): 1057-1083.[8] Beno J H. Mobot the Robot[R]. SAE Technical Paper, 1962.[9] Fitzgerald C. Developing baxter[C]//2013 IEEE conference on technologies forpractical robot applications (TePRA). IEEE, 2013: 1-6.[10] Ott C, Eiberger O, Friedl W, et al. A humanoid two-arm system for dexterousmanipulation[C]//Proceedings of the 6th IEEE-RAS International Conference onHumanoid Robots. Genoa, Italy: IEEE, 2006: 276-283.[11] Odashima T, Onishi M, Tahara K, et al. Development and evaluation of a human-interactive robot platform “RI-MAN” [J]. Journal of the Robotics Society ofJapan, 2007, 25(4): 554-565.[12] Iwata H, Sugano S. Design of human symbiotic robot TWENDY-ONE[C]//Proceedings of the 2009 IEEE International Conference on Roboticsand Automation. Kobe, Japan: IEEE, 2009: 580-586.[13] Levinger J, Hofmann A, Theobald D. Semiautonomous control of an emergencyresponse robot[C]//AUVSI Unmanned Systems North America Conference, SanDiego, CA. 2008: 914-927.[14] Ding J, Lim Y J, Solano M, et al. Giving patients a lift—the robotic nursingassistant (RoNA)[C]//Proceedings of the 2014 IEEE International Conference onTechnologies for Practical Robot Applications (TePRA). Woburn, MA, USA:IEEE, 2014: 1-6.[15] Choi B, Lee W, Park G, et al. Development and control of a military rescue robotfor casualty extraction task [J]. Journal of Field Robotics, 2019, 36(4): 656-676.[16] Chung W K, Yang Y, Cui N, et al. Design of a rescue robot with a wearable suitaugmenting high payloads rescue missions[C]//Proceedings of the 2017 2ndInternational Conference on Advanced Robotics and Mechatronics (ICARM).Hefei, China: IEEE, 2017: 182-187.[17] 郭继录. 双臂救援机器人结构设计与分析 [D].沈阳理工大学,2021.[18] Beebe M M K, Ret C D R U. United States Department of Defense Research inRobotic Unmanned Systems for Combat Casualty Care[J]. 2010.[19] Ohno K, Morimura S, Tadokoro S, et al. Semi-autonomous control system ofrescue crawler robot having flippers for getting over unknown-steps[C]//Proceedings of the 2007 IEEE/RSJ International Conference onIntelligent Robots and Systems. San Diego, CA, USA: IEEE, 2007: 3012-3018.[20] Ben-Tzvi P, Williams A, Sebastian B, et al. Semi-autonomous victim extractionrobot (SAVER)[P]. US Provisional Patent Application 62/660,869, 2018[21] Saputra R P, Rakicevic N, Kuder I, et al. Resqbot 2.0: An improved design of amobile rescue robot with an inflatable neck securing device for safe casualtyextraction [J]. Applied Sciences, 2021, 11(12): 5414.[22] Iwano Y, Osuka K, Amano H. Development of stretcher component robots forrescue activity[C]//Proceedings of the 2004 IEEE Conference on Robotics,Automation and Mechatronics. Bangkok, Thailand: IEEE, 2004: 365-370.[23] Edlinger R, Föls C, Nüchter A. An innovative pick-up and transport robot systemfor casualty evacuation[C]//2022 IEEE International Symposium on Safety,Security, and Rescue Robotics (SSRR). IEEE, 2022: 67-73.[24] 肖子轩. 刚柔耦合多臂协作全地形行走救援机器人设计分析与实验 [D],燕山大学, 2021.[25] Newcombe R A, Fox D, Seitz S M. Dynamicfusion: Reconstruction and trackingof non-rigid scenes in real-time[C]//Proceedings of the IEEE conference oncomputer vision and pattern recognition. 2015: 343-352.[26] Newcombe R A, Izadi S, Hilliges O, et al. KinectFusion: Real-time dense surfacemapping and tracking[C]//Proceedings of the 2011 10th IEEE InternationalSymposium on Mixed and Augmented Reality. Basel, Switzerland: IEEE, 2011:127-136.[27] Yu T, Guo K, Xu F, et al. BodyFusion: Real-time capture of human motion andsurface geometry using a single depth camera[C]//Proceedings of the IEEEInternational Conference on Computer Vision. Venice, Italy: IEEE, 2017: 910-919.[28] Yu T, Zheng Z, Guo K, et al. DoubleFusion: Real-time capture of humanperformances with inner body shapes from a single depth sensor[C]//Proceedingsof the IEEE Conference on Computer Vision and Pattern Recognition. Salt LakeCity, UT, USA: IEEE, 2018: 7287-7296.[29] Dou M, Khamis S, Degtyarev Y, et al. Fusion4d: Real-time performance captureof challenging scenes [J]. ACM Transactions on Graphics (ToG), 2016, 35(4): 1-13.[30] Xu L, Su Z, Han L, et al. Unstructuredfusion: realtime 4d geometry and texturereconstruction using commercial rgbd cameras [J]. IEEE transactions on patternanalysis and machine intelligence, 2019, 42(10): 2508-2522.[31] Marr D, Nishihara H K. Representation and recognition of the spatialorganization of three-dimensional shapes [J]. Proceedings of the Royal Societyof London Series B Biological Sciences, 1978, 200(1140): 269-294.[32] Pentland A, Horowitz B. Recovery of nonrigid motion and structure [J]. IEEETransactions on Pattern Analysis & Machine Intelligence, 1991, 13(07): 730-742.[33] Anguelov D, Srinivasan P, Koller D, et al. Scape: shape completion andanimation of people[M]//ACM SIGGRAPH 2005 Papers. 2005: 408-416.[34] Loper M, Mahmood N, Romero J, et al. SMPL: A Skinned Multi-Person LinearModel[J]. ACM Transactions on Graphics, 2015, 34(6).[35] Romero J, Tzionas D, Black M J. Embodied hands: Modeling and capturin